OpenAI'ın yeni video üreticisi Sora, güçlü yeteneklerine rağmen bazı kısıtlamalar içeriyor. Yapay zeka modelinin kötüye kullanımını engellemek için, gerçek insanları içeren görsellerin yüklenmesi büyük ölçüde sınırlandırıldı. Bu durum, deepfake'ler ve yanlış bilgi yayılımı gibi olası risklere karşı alınmış önemli bir güvenlik önlemidir. Şirket, sadece sınırlı sayıda kullanıcıya insan görselleriyle video oluşturma izni verdiğini açıkladı. Bu seçili kullanıcılar, OpenAI'ın sistemini test etmesi ve olası riskleri değerlendirmesi için belirlendi. Sistem, insan tasvirlerini içeren videoların üretilmesini dikkatlice denetliyor ve potansiyel kötüye kullanımları tespit etmek için sürekli olarak geliştiriliyor. Teknoloji dünyasında büyük yankı uyandıran Sora, yüksek talebe rağmen şu an için herkese açık değil.

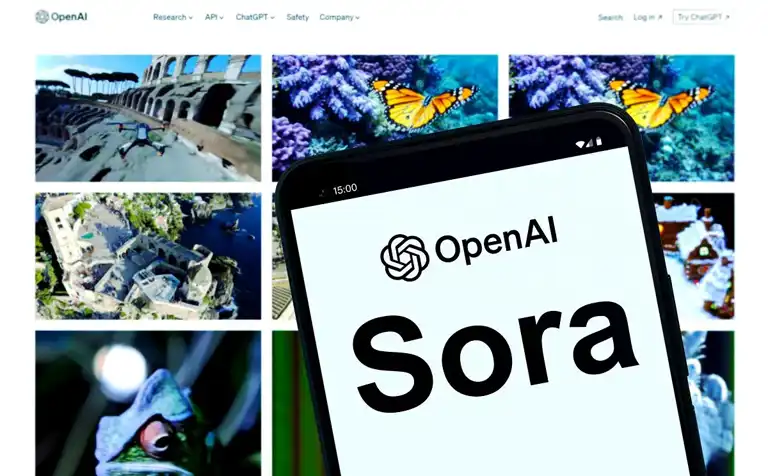

OpenAI, Sora'da İnsan Görsellerini Kısıtlıyor

OpenAI'ın yeni video üreticisi Sora, güçlü yeteneklerine rağmen bazı kısıtlamalar içeriyor. Yapay zeka modelinin kötüye kullanımını engellemek için, gerçek insanları içeren görsellerin yüklenmesi büyük ölçüde sınırlandırıldı. Bu durum, deepfake'ler ve yanlış bilgi yayılımı gibi olası risklere karşı alınmış önemli bir güvenlik önlemidir. Şirket, sadece sınırlı sayıda kullanıcıya insan görselleriyle video oluşturma izni verdiğini açıkladı. Bu seçili kullanıcılar, OpenAI'ın sistemini test etmesi ve olası riskleri değerlendirmesi için belirlendi. Sistem, insan tasvirlerini içeren videoların üretilmesini dikkatlice denetliyor ve potansiyel kötüye kullanımları tespit etmek için sürekli olarak geliştiriliyor. Teknoloji dünyasında büyük yankı uyandıran Sora, yüksek talebe rağmen şu an için herkese açık değil.

Teknoloji haberleri, incelemeleri ve rehberleri burada! En yeni gadget'lardan yazılımlara, siber güvenliğe kadar her şey için tek adresiniz. Güncel kalın, bilinçli kararlar verin. #teknoloji #haber #inceleme #rehber<br/>

Teknoloji haberleri, incelemeleri ve rehberleri burada! En yeni gadget'lardan yazılımlara, siber güvenliğe kadar her şey için tek adresiniz. Güncel kalın, bilinçli kararlar verin. #teknoloji #haber #inceleme #rehber<br/>